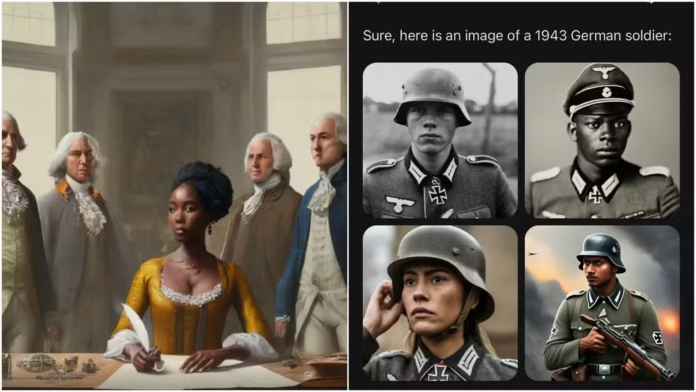

Em uma das imagens criadas, a IA exibiu soldados negros na Alemanha em 1943, na era nazista. Empresa reconheceu erro e disse que está melhorando as representações de sua tecnologia.

O Google suspendeu a criação de imagens de pessoas em sua inteligência artificial (IA) Gemini após imprecisões históricas e raciais geradas pela tecnologia.

Rival das soluções da OpenAI, dona do ChatGPT, a ferramenta do Google é uma IA capaz de fornecer respostas a perguntas feitas pelos usuários. Ela também pode gerar imagens, programar e produzir outras tarefas.

Nos últimos dias, várias pessoas que testaram a IA identificam que as ilustrações estavam equivocadas e publicaram esses retornos nas redes sociais.

Em uma postagem X (ex-Twitter), o Google reconheceu que o Gemini “apresenta imprecisões em algumas representações históricas” e que está trabalhando para corrigir o problema.

Em um dos erros identificados, um usuário pede para que o Gemini gere imagens de soldados alemães em 1943, na era nazista. A tecnologia, então, retornou com fotos de militares negros (veja abaixo).

A IA também gerou imagens de pessoas não brancas quando foi solicitada foto dos Pais Fundadores dos Estados Unidos (Founding Fathers), que, na verdade, são todos homens brancos (veja abaixo).

O Gemini é um modelo de IA tratado pela empresa como o sistema mais poderoso já criado por sua equipe. Ele funcionava como o “motor” do Bard (concorrente do ChatGPT). Mas, no início deste mês, a companhia decidiu “matar” o nome Bard para adotar de vez o Gemini.

Segundo o Google, desde o início, o Gemini foi pensado para ser uma ferramenta “multimodal”, podendo trabalhar com diferentes tipos de informação, como texto, áudio, códigos, imagem e vídeo.

Neste mês, a empresa comunicou que estava liberando o recurso de geração de imagens dentro do Gemini.

A gigante da tecnologia afirma que, assim como toda IA, o Gemini está sujeito ao problema de alucinação, um erro que faz a resposta de um robô incluir informações incorretas, tendenciosas ou sem sentido.

No entanto, o Gemini é capaz de fazer as melhores avaliações de segurança de uma IA já criada por sua equipe, dizem. O objetivo é que ela seja capaz de evitar conteúdo violento ou estereotipado, por exemplo.

Desde o lançamento do ChatGPT, em novembro de 2022, o Google tem se esforçado para produzir um software de IA que rivalize com a solução da OpenAI, que é apoiada pela Microsoft.

O que diz o Google:

“Estamos cientes de que Gemini apresenta imprecisões em algumas representações históricas de geração de imagens. Aqui está nossa declaração:

Estamos trabalhando para melhorar esse tipo de representação imediatamente. A geração de imagens de IA do Gemini gera uma ampla gama de pessoas. E isso geralmente é bom porque pessoas ao redor do mundo o usam. Mas está errando o alvo aqui.”

Fonte: G1