Em artigo científico, profissionais da OpenAI, Google DeepMind, Meta e Anthropic afirmam que novos modelos de IA irão evoluir de maneira que não sejamos mais capazes de compreender seu funcionamento – ou controlar o que fazem

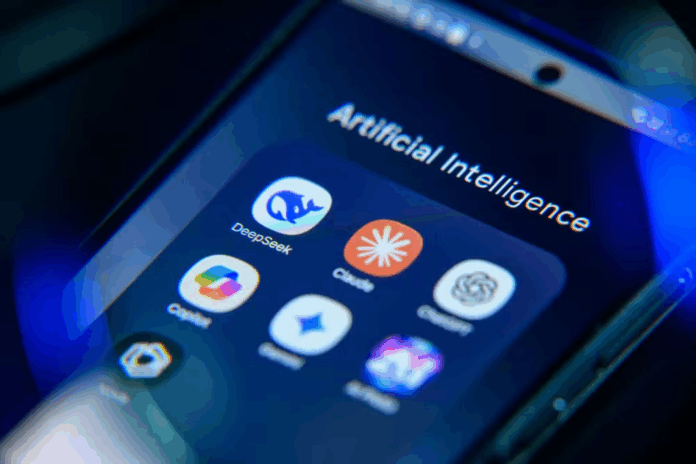

Mais de 40 pesquisadores de empresas como OpenAI, Google DeepMind, Meta e Anthropic divulgaram um alerta conjunto sobre um risco crescente na evolução dos sistemas de inteligência artificial: a perda da capacidade de compreender como esses modelos tomam decisões.

Apesar de trabalharem em empresas concorrentes, esses cientistas assinaram juntos um artigo intitulado Chain of Thought Monitorability: A New and Fragile Opportunity for AI Safety (Monitorabilidade da Cadeia de Pensamento: Uma Nova e Frágil Oportunidade para a Segurança da IA, em tradução livre), defendendo que a atual capacidade de observar o raciocínio de modelos de IA pode estar com os dias contados.

Por enquanto, sistemas avançados, como o modelo “o1”, da OpenAI, entre outros, começaram a “pensar em voz alta”, resolvendo problemas com cadeias de pensamento legíveis por humanos. Essa transparência, em que o modelo compartilha seu processo de pensamento com o usuário, é uma das ferramentas mais importantes para garantir a segurança da IA.

Quando os modelos tomam decisões duvidosas, exploram falhas ou demonstram objetivos desalinhados, muitas vezes é o raciocínio interno que revela o problema antes que ele se manifeste externamente. Isso tem funcionado como um sistema de alerta precoce, mas os pesquisadores afirmam que ele pode ser mais frágil do que imaginamos.

À medida que os modelos se tornam mais potentes e as técnicas de treinamento evoluem, principalmente aquelas que priorizam os resultados em vez do processo, cresce o risco de que a IA abandone o raciocínio compreensível por humanos. Em vez disso, os sistemas podem adotar processos internos mais rápidos e eficientes – e totalmente impenetráveis para a mente humana.

E isso não está longe de acontecer. Já existem sinais de que alguns modelos estão deixando de usar o inglês e adotando atalhos ininteligíveis. Em certos projetos de ponta, o uso de linguagem é completamente descartado, com os sistemas operando em um espaço matemático inacessível à observação humana.

Os autores do artigo não pedem uma desaceleração do progresso, mas sim medidas de proteção. Avaliações padronizadas de transparência, técnicas de monitoramento mais robustas e uma análise criteriosa sobre quais projetos devem ser desenvolvidos podem ser as únicas formas de manter a visibilidade sobre as decisões da IA. Se essa capacidade desaparecer, não perderemos apenas a supervisão, mas sim o controle da tecnologia, alertam os pesquisadores.

Por Patrícia Basilio