Há décadas, IA desempenha papel no setor que vai da avaliação de crédito e fraudes à inclusão financeira

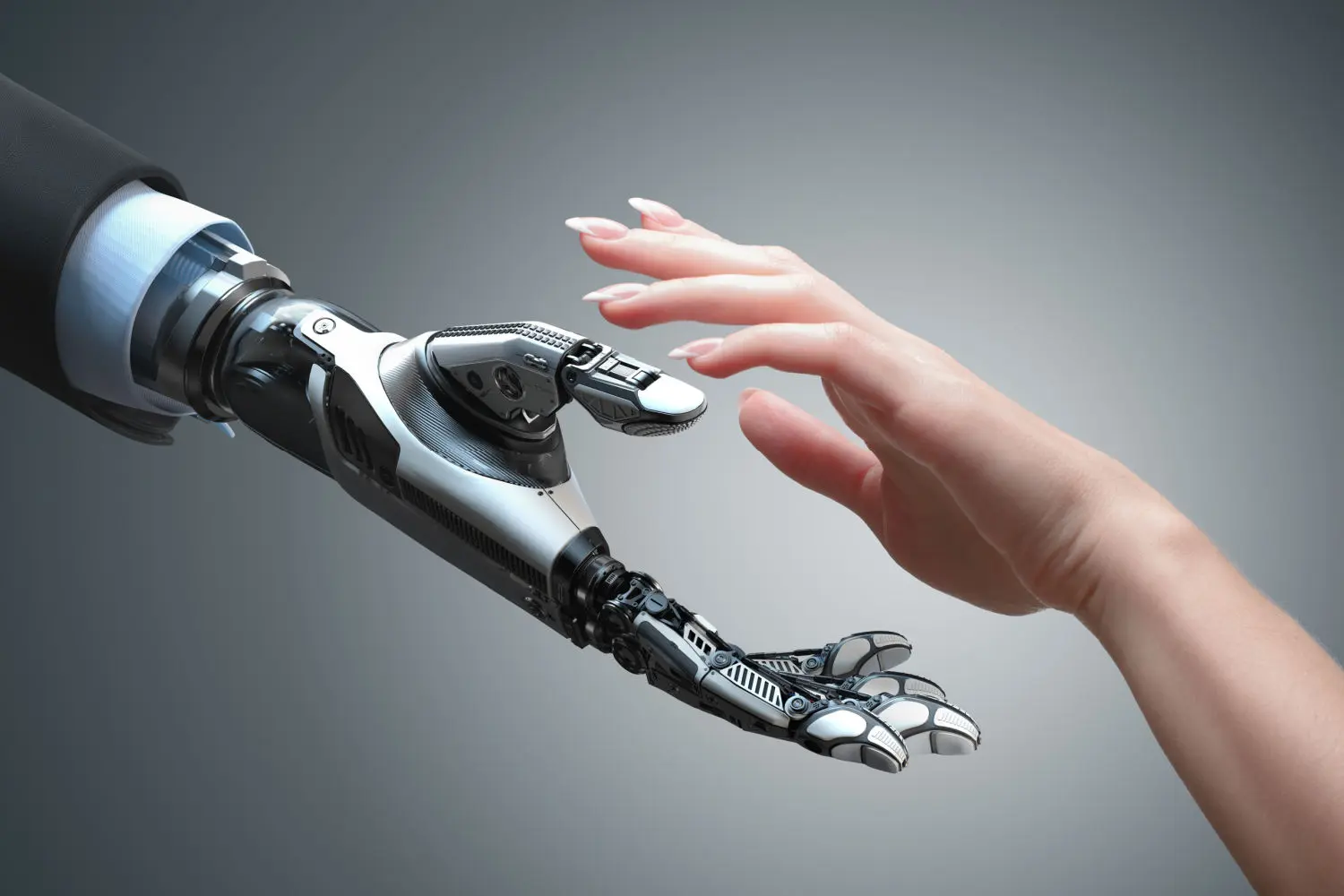

A Inteligência Artificial (IA) tem sido usada em diferentes áreas e está tão presente no dia a dia das pessoas que pode passar despercebida. A lista de ferramentas que leva IA embarcada – e é usada por milhões de pessoas -, é imensa: assistentes de voz, rotas de tráfego, reconhecimento facial, serviços de streaming e as redes sociais são alguns exemplos clássicos. No segmento financeiro não é diferente.

Há décadas, a Inteligência Artificial desempenha um papel importantíssimo que vai desde uma avaliação de crédito e fraudes, passando pelo onboarding e experiência do cliente, e chegando, inclusive, no papel social de contribuir para a inclusão financeira.

Mas, há limite para o aprendizado e para uso ético dessas informações?

Para falarmos do uso da Inteligência Artificial no setor financeiro e os limites ou riscos da ferramenta para tomada de decisão, é preciso dar um passo atrás e explicar o papel da IA e do Machine Learning nesse processo.

A Inteligência Artificial (IA) e o Machine Learning (ML) são conceitos que estão relacionados, mas, atuam de forma independente. Enquanto o Machine Learning atua com a capacidade de aprendizado a partir de um conjunto de dados, a IA direciona ações baseadas em dados.

Dito isto, reforço a mensagem principal desse artigo: a máquina não aprende sozinha. Precisa de olhos e do cérebro humano para conduzir, questionar, alinhar e retirar vieses para uma operação explicável, ética e auditável. Ou seja, é preciso retroalimentar o sistema para categorizar riscos considerando questões sociais, ambientais e de governança corporativa.

Um artigo da Wharton University of Pennsylvania destacou quatro categorias de riscos: relativos a dados, ataque aos sistemas; testes e confiabilidade; e compliance. A desatenção a um desses aspectos pode gerar um efeito adverso, que vai desde a aprovação ou reprovação indevida de um cliente e/ou de uma compra, até abalar a reputação de uma marca/empresa.

Limitações de aprendizado e qualidade de dados

O primeiro tópico refere-se a reconhecer as limitações do sistema de IA. Por mais completa que seja a base de dados, diferentes cenários resultam em julgamentos diferentes e as máquinas não conseguem ponderar o contexto em que os dados foram gerados.

Portanto, as decisões podem ser tomadas de forma errônea, discriminatória ou, ainda, desalinhadas com o objetivo principal da instituição, se não houver uma revisão cuidadosa e criteriosa da base que alimenta a Inteligência Artificial.

Ataques

As categorias que mais concentram os ataques aos sistemas de Inteligência Artificial e Machine Learning estão relacionadas à privacidade de dados, em que o invasor busca vazar informações confidenciais e sensíveis dos clientes; ou ao envenenamento de dados, que acontece quando o invasor contamina os dados coletados para criar um perfil tendencioso, o que compromete o retreinamento do modelo.

Testes e Confiabilidade

Não há sistema de Inteligência Artificial e de Machine Learning que sobreviva sem revisões periódicas e questionamentos sobre o que se espera captar com aquela tecnologia. Olhar com superficialidade para os resultados de um modelo pode gerar respostas duvidosas.

Portanto, é importante acompanhar e questionar frequentemente as saídas do modelo, com o objetivo de corrigir rotas e trazer decisões com mais qualidade e representatividade.

Nesse sentido, a questão da transparência também é evidenciada. E para nós aqui no Brasil – que ainda temos uma parcela significativa da população com restrição ao crédito-, o tema ganha mais relevância, uma vez que por meio da IA e do ML é possível incluir pessoas no sistema de crédito ou ao menos, propor mudanças e soluções que contribuam para isso.

Compliance

As regulações devem evoluir à medida que os sistemas de Inteligência Artificial e os cenários são transformados. A questão do score, por exemplo, tem diferentes entendimentos mundo afora. Nos Estados Unidos, todos os clientes que têm o crédito negado possuem o direito de saber o motivo.

Se a mesma prática estivesse em vigor aqui no Brasil, seria uma oportunidade de conscientizar o cliente dos pontos de atenção e como melhorar essa pontuação.

Melhores práticas

A mitigação de riscos perpassa um complexo processo de inclusão e alimentação de dados, revisão contínua de vieses e cenários, com foco em reduzir a questão discriminatória, garantindo também a explicabilidade e a governança.

Um comitê de ética diverso, ajuda a pensar diferente, compartilha de aprendizados e vivências variadas e olhares para lugares incomuns, o que contribui para inserir orientações no treinamento e aplicação da Inteligência Artificial ética.

A proposta é garantir que os sistemas de Inteligência Artificial e Machine Learning sejam inteligíveis, adaptáveis, confiáveis e não uma caixa preta de informações.

É com essa mentalidade que evoluímos no uso da tecnologia.

*Celina Koshimizu é consultora de negócios da FICO

Fonte: IT Forum