Um usuário do Reddit descobriu os códigos do Apple Intelligence na versão beta do macOS 15.1 Sequoia, e alguns pontos chamam a atenção. Entre as instruções predefinidas, há comandos como “não alucine” e “não invente informações factuais”.

Os códigos mostram que, antes de funções simples como auxiliar a reescrever trechos ou resumir e-mails, há uma série de instruções em linguagem natural, escritas em inglês, que definem como deve ser a resposta em termos de formato, tamanho e informações.

“Você é um assistente prestativo”

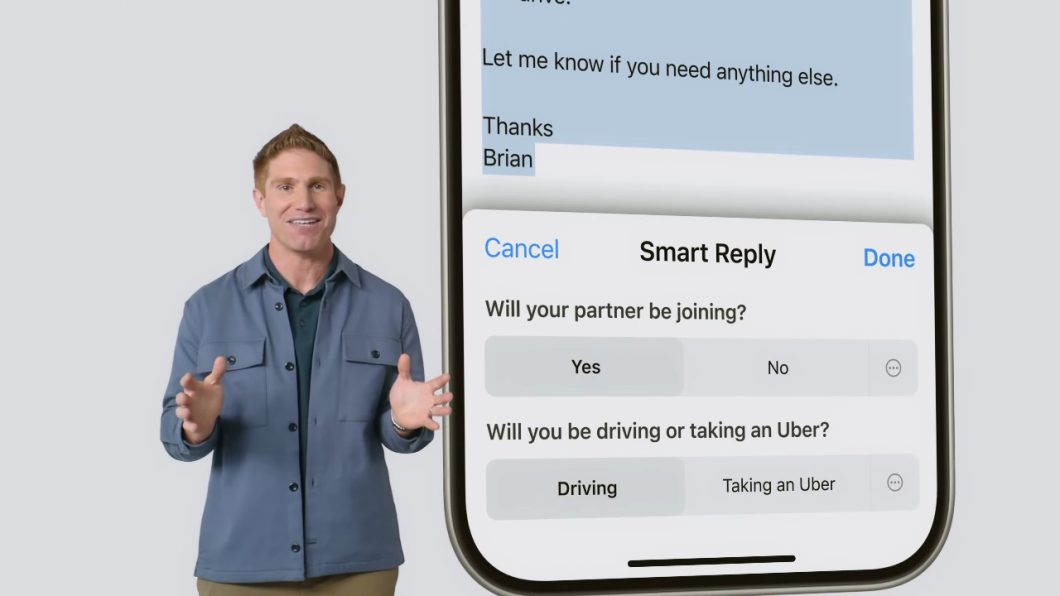

Mesmo sem identificação, é possível deduzir o que cada um fará na IA da Apple. Um deles, por exemplo, contém os trechos (reproduzidos aqui em tradução livre) “você é um assistente de email prestativo”, “faça perguntas relevantes, que estejam explícitas no email” e “não faça perguntas já respondidas no trecho”. Provavelmente, isso serve para resumir uma mensagem recebida e sugerir respostas.

Em outro trecho, o código do Apple Intelligence contém a seguinte instrução: “Por favor, limite a resposta a 50 palavras. Não alucine. Não invente informações factuais”. No jargão da inteligência artificial, “alucinação” é o nome dado às respostas escritas de forma coerente, em termos de linguagem, mas com dados incorretos ou simplesmente fictícios.

Os códigos vão além de tarefas envolvendo texto. Um trecho pede para gerar um arquivo estruturado com imagens que formem uma história, conforme solicitado pelo usuário. “A história deve conter um arco claro. A história deve ser diversa, isto é, não concentre a história em um tema ou característica.”

Também há um pedaço com instruções para não criar uma história negativa, triste ou provocativa, nem que envolva temas religiosos, políticos, nocivos, violentos, sexuais ou obscenos. Ele provavelmente pertence ao aplicativo Fotos.

ChatGPT também tem instruções personalizadas

A abordagem de incluir instruções predefinidas parece visar um resultado mais próximo do esperado para o usuário e para a própria Apple. Segundo fontes internas, a companhia teme que alucinações da IA possam arranhar sua reputação.

Mesmo assim, é curioso que isso seja feito em linguagem natural, sem ajustes técnicos — e difícil acreditar que dizer “não alucine” seja suficiente para uma IA não alucinar.

Esta tática não é inédita e está presente em softwares bem menos refinados que o Apple Intelligence. O programa de apoio da Logitech, por exemplo, tem atalhos para acessar o ChatGPT e usar “receitas”. Elas são pedidos prontos; o app cola as instruções, o trecho que o usuário selecionou e manda tudo para o assistente de IA.

O próprio ChatGPT oferece instruções personalizadas como parte de seu plano Plus. Com elas, o usuário pode definir de antemão como quer que o chatbot responda — gerar códigos eficientes sem comentários ou listas de compras levando em consideração uma família de seis pessoas, por exemplo.

Por Giovanni Santa Rosa, com informações: The Verge